1. Deepfake không còn là vấn đề media mà là hạ tầng tấn công

Deepfake từng được xem chủ yếu như một hiện tượng của truyền thông số, gắn với video giả mạo, voice clone hay hình ảnh bị chỉnh sửa. Tuy nhiên, trong Deepfake trong Web3, bản chất của vấn đề đã thay đổi. Deepfake không còn nằm ở tầng nội dung, mà đã tiến hóa thành một mối đe dọa ở cấp độ hạ tầng.

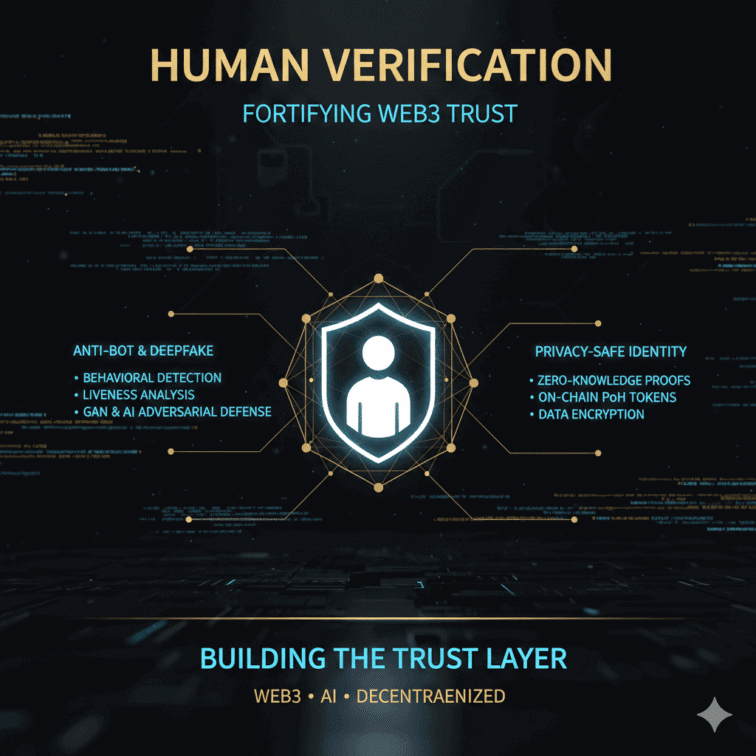

Điểm khác biệt cốt lõi nằm ở kiến trúc Web3. Hệ sinh thái này không có trung gian xác minh con người. Danh tính số, quyền truy cập, quyền biểu quyết và tài sản được gắn trực tiếp với chữ ký và hành vi số. Trong khi đó, AI hiện đại có thể giả mạo chính xác những tín hiệu từng được xem là chỉ con người mới tạo ra.

Hệ quả là nếu không tồn tại một Human Verification layer độc lập, toàn bộ trust layer của Web3 có thể bị phá vỡ chỉ bằng các AI identity được sinh ra hàng loạt.

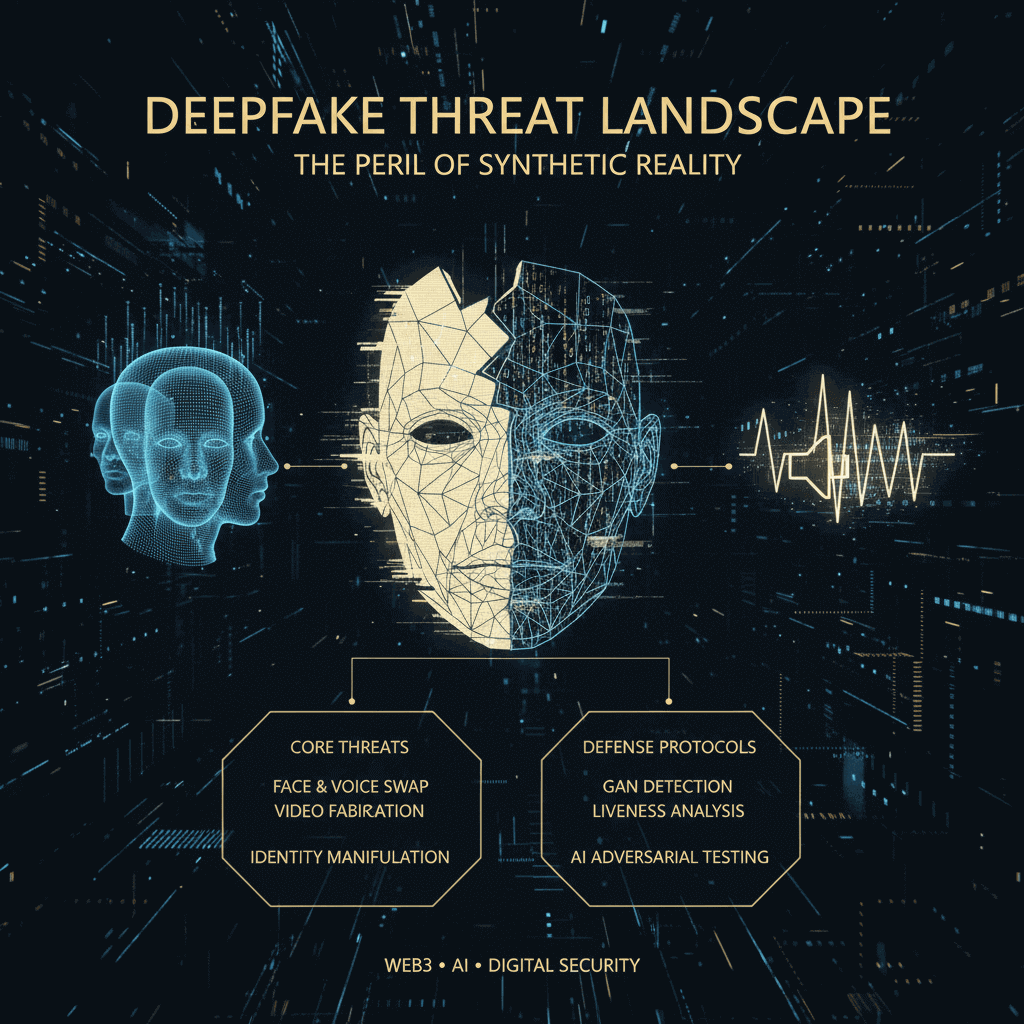

2. Phân loại mối đe dọa Deepfake trong Web3

2.1 Face Deepfake

Face deepfake tập trung vào việc tạo hoặc thay thế gương mặt trong video theo thời gian thực. Các kỹ thuật phổ biến bao gồm GAN, diffusion model và face reenactment, cho phép đạt độ chân thực rất cao.

Trong bối cảnh Web3, face deepfake có thể vượt qua KYC qua video call, đánh lừa các cơ chế liveness đơn giản và xâm nhập vào các quy trình xác minh DAO hoặc PoP dựa trên sinh trắc học. Về mặt kỹ thuật, loại deepfake này có độ trung thực hình ảnh cao, chạy real time với độ trễ thấp và gần như không thể phân biệt bằng mắt thường.

2.2 Voice Deepfake

Voice deepfake cho phép clone giọng nói chỉ từ vài giây audio và tạo speech theo ngữ cảnh động. Điều này mở ra các kịch bản tấn công social engineering trong DAO governance, vượt qua xác thực dựa trên giọng nói và giả mạo voice command cho các wallet assistant.

Rủi ro đặc thù của voice deepfake nằm ở việc giọng nói là tín hiệu dễ bị tin tưởng sai, trong khi không tồn tại yếu tố hình ảnh để đối chiếu chéo.

2.3 Video Deepfake đa phương thức

Video deepfake kết hợp đồng thời gương mặt, giọng nói và lip-sync, đồng thời có khả năng phản hồi theo thời gian thực. Loại tấn công này có thể phá vỡ hoàn toàn các cơ chế xác thực dựa trên video và nhắm trực tiếp vào các tài khoản giá trị cao như DAO treasurer, signer hoặc validator.

3. Vì sao Deepfake đặc biệt nguy hiểm với Web3

3.1 Không có trung tâm xác thực và khả năng rollback

Web2 vẫn tồn tại các lớp bảo vệ như moderation, account recovery và can thiệp pháp lý. Web3 thì không. Một khi deepfake vượt qua xác thực, quyền biểu quyết có thể bị chiếm, token có thể bị chuyển và kết quả governance có thể bị thao túng mà không có khả năng rollback.

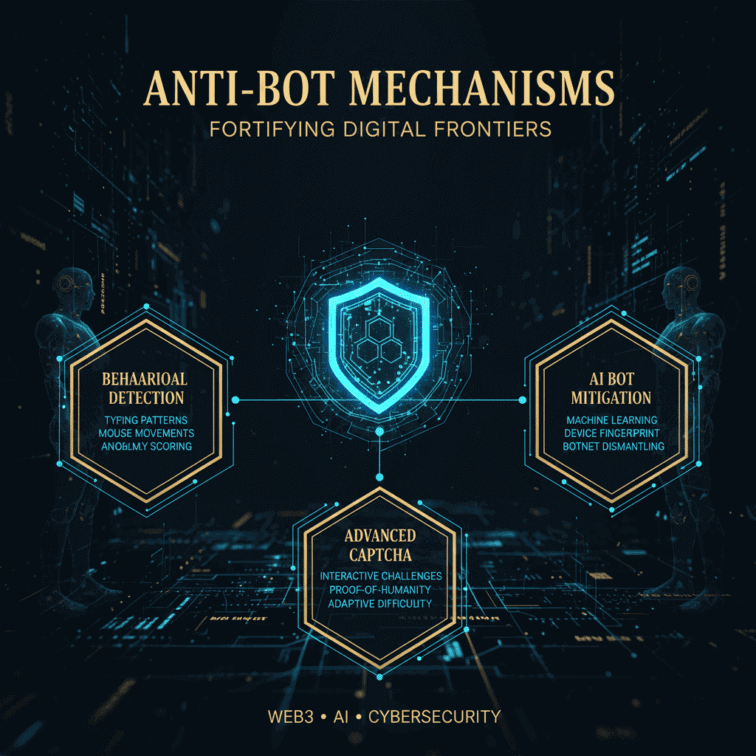

3.2 Khuếch đại tấn công với AI, bot và Sybil

Deepfake không hoạt động đơn lẻ. Một stack tấn công điển hình bắt đầu từ AI sinh hàng loạt danh tính giả, bot điều phối hành vi, deepfake cung cấp tín hiệu con người, và cuối cùng là Sybil attack chiếm governance hoặc incentive. Đây là một dạng tấn công mang tính hệ thống, không phải các sự cố rời rạc.

4. Detection Stack cho Deepfake

4.1 GAN Detection

GAN detection dựa trên việc phân tích các artifact do GAN tạo ra, bao gồm texture, bất nhất pixel và đặc trưng trong frequency domain. Các kỹ thuật phổ biến sử dụng CNN-based classifier, phân tích Fourier và mô hình hóa noise residual. Tuy nhiên, khi GAN liên tục cải tiến, detection rơi vào trạng thái cat and mouse và dễ phát sinh false negative nếu model lỗi thời.

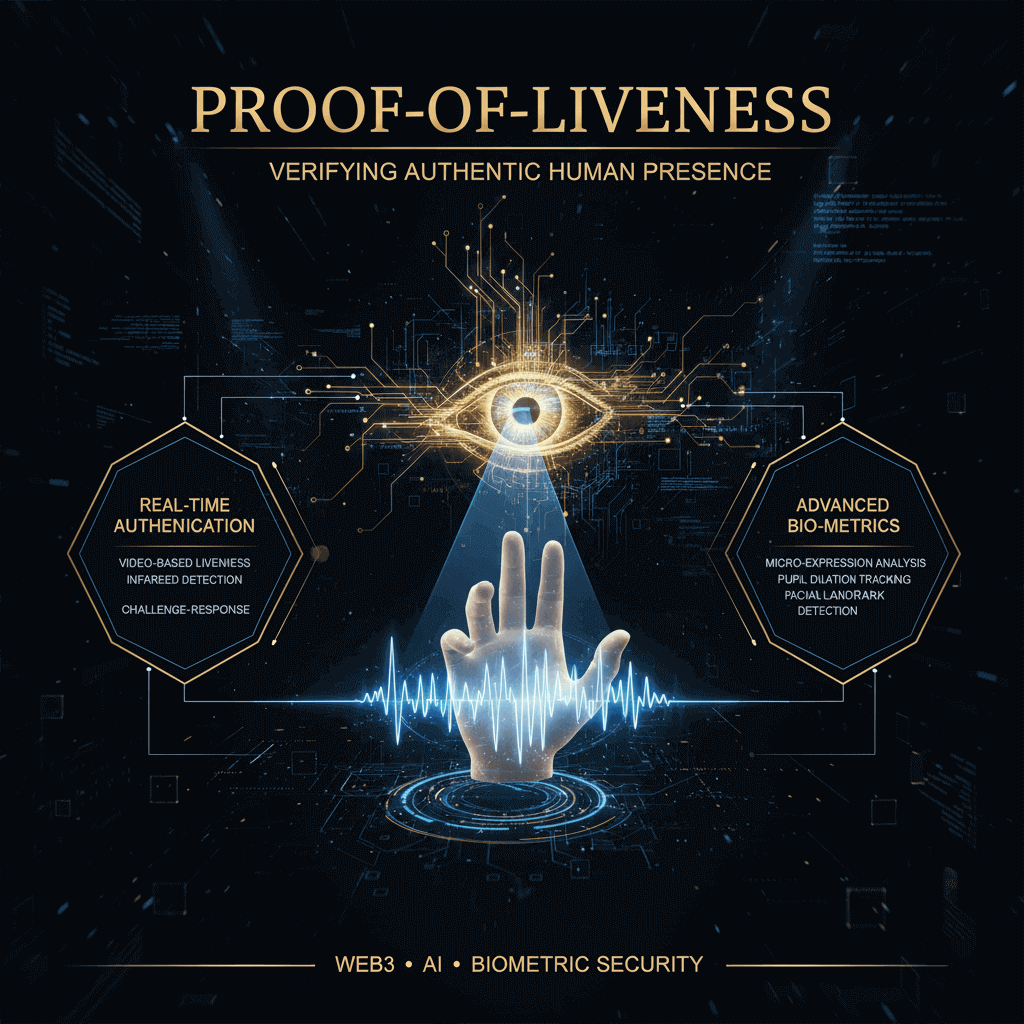

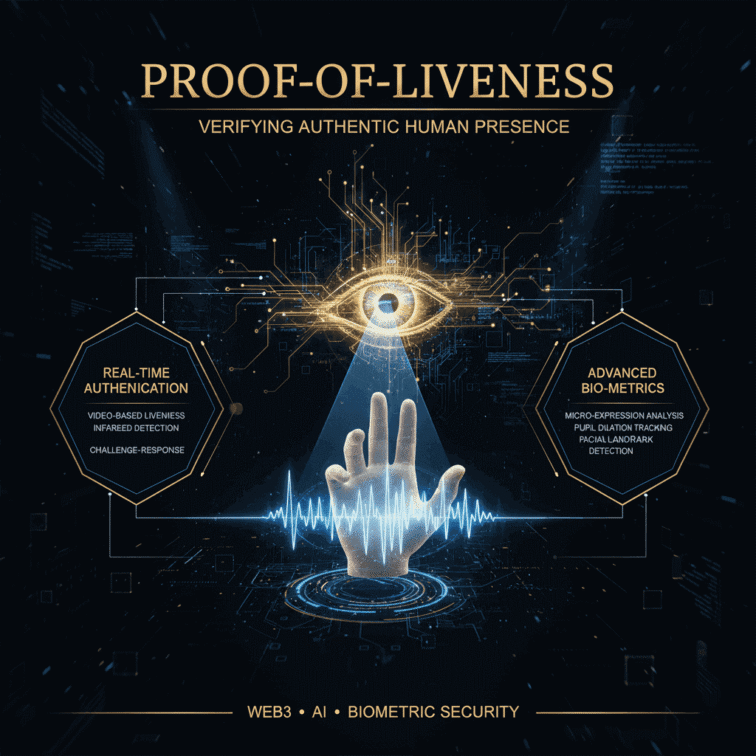

4.2 Liveness Analysis giai đoạn trước ZK

Liveness analysis nhằm phân biệt con người thật với replay hoặc nội dung tổng hợp. Các tín hiệu thường được khai thác bao gồm micro-movement như blink, pupil dilation, sự ngẫu nhiên của head pose và độ trễ tương tác. Dù vậy, liveness đơn thuần không còn đủ mạnh trước các deepfake real time.

4.3 Kiểm tra tính nhất quán đa phương thức

Cách tiếp cận này so sánh chéo giữa gương mặt và giọng nói, chuyển động môi và audio, phản ứng và thời gian prompt. Deepfake thường khó đạt độ hoàn hảo trên tất cả các kênh cùng lúc, tạo ra điểm yếu cho detection.

4.4 AI Adversarial Testing

AI adversarial testing chủ động tấn công hệ thống xác thực bằng các mẫu deepfake được sinh ra, qua đó stress test mô hình phát hiện. Phương pháp này giúp đánh giá robustness và tránh overfitting vào một loại deepfake cụ thể.

5. Trade off giữa Detection và Privacy

Detection mạnh thường đòi hỏi thu thập dữ liệu nhiều hơn, trong khi privacy yêu cầu hạn chế dữ liệu và tránh tập trung hóa. On device processing có thể cải thiện cả hai phía, nhưng centralized model luôn tiềm ẩn rủi ro. Việc tích hợp ZK nâng cao privacy nhưng làm tăng độ phức tạp kiến trúc. Đây là lý do xác thực con người không thể chỉ dựa vào AI detection, mà phải được thiết kế theo hướng privacy preserving ngay từ đầu.

6. Hàm ý kiến trúc: Nhu cầu Human Verification Layer

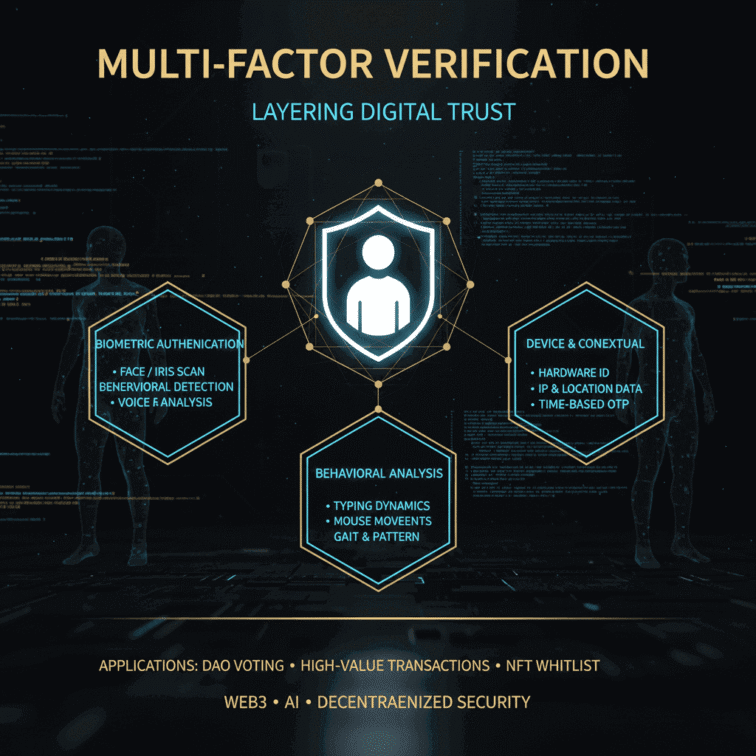

Deepfake buộc Web3 phải từ bỏ tư duy xác thực một lần. Thay vào đó là xác thực liên tục, đa chiều và khó giả mạo. Human Verification layer cần không phụ thuộc vào một tín hiệu đơn lẻ như face hay voice, có khả năng chống AI generated behavior, không lưu trữ biometric thô và có thể tích hợp logic on chain.

7. Các use case Web3 chịu ảnh hưởng nặng

7.1 DAO Governance

Deepfake delegate có thể xuất hiện trong các cuộc gọi, thao túng sentiment và tạo false consensus, làm sai lệch kết quả governance.

7.2 NFT và Airdrop

Deepfake được dùng để giả mạo người dùng thật, claim incentive hàng loạt và phá vỡ tokenomics.

7.3 AI Wallet và Smart Wallet

Deepfake chủ ví kết hợp social engineering và AI có thể lừa wallet agent ký transaction, gây thiệt hại trực tiếp về tài sản.

8. Deepfake và các lớp bảo vệ hiện tại

CAPTCHA chỉ hiệu quả với bot, không chống được deepfake. Behavioral detection và liveness cơ bản chỉ mang tính cảnh báo. Chỉ các hệ thống xác thực con người đa lớp mới có khả năng chống cả bot lẫn deepfake.

9. Quỹ đạo đe dọa trong tương lai

Deepfake đang tiến tới self improving agent, phối hợp đa tác tử, tổng hợp đồng thời voice, face và hành vi, và nhắm vào các cuộc tấn công governance có chủ đích. Trong bối cảnh đó, xác thực con người trở thành hạ tầng cốt lõi chứ không còn là một feature phụ trợ.

10. Kết luận

Deepfake trong Web3 đã vượt khỏi ranh giới fake media để trở thành mối đe dọa hệ thống đối với danh tính số, governance, tokenomics và trust score. Nếu thiếu một Human Verification layer, Web3 sẽ không phân biệt được người và AI, không chống được sự kết hợp giữa Sybil và deepfake, và không thể duy trì trust phi tập trung. Câu hỏi không còn là deepfake có xảy ra hay không, mà là hệ thống đã chuẩn bị lớp hạ tầng nào để đối phó.

Bài viết này chỉ là một lát cắt, toàn bộ kiến trúc xác minh con người trong Web3 được trình bày đầy đủ tại:

[SILO 5 – Human Verification].

Xem tiếp bài viết:

[5.4 – Proof of Liveness trong Web3]

“Khuyến cáo: Nội dung chỉ để nghiên cứu-giáo dục, không phải tư vấn đầu tư và không bảo chứng cho bất kỳ hoạt động crypto nào. Người đọc tự chịu trách nhiệm.”

Hệ sinh thái – ZRO Research

🌐 Website: https://zro.vn

📧 Email: zroresearch@gmail.com

🐦 X (Twitter): https://x.com/zroresearch

💬 Telegram: https://t.me/zroresearch

🎵 TT: https://www.tiktok.com/@zroresearch

📘 Facebook: https://facebook.com/zroresearch

📸 Insta: https://instagram.com/zroresearch

▶️ YouTube: https://youtube.com/@zroresearch