Khi “quy trình” bắt đầu thay thế con người!

Khi không còn ai để hỏi

AI cần ràng buộc vì có những ngày rất bình thường, bạn đăng nhập vào một tài khoản đã gắn bó cả chục năm và phát hiện nó không còn tồn tại. Không có cảnh báo trước, không có email giải thích. Thứ duy nhất xuất hiện trên màn hình là một dòng thông báo ngắn gọn: “Tài khoản vi phạm tiêu chuẩn cộng đồng”.

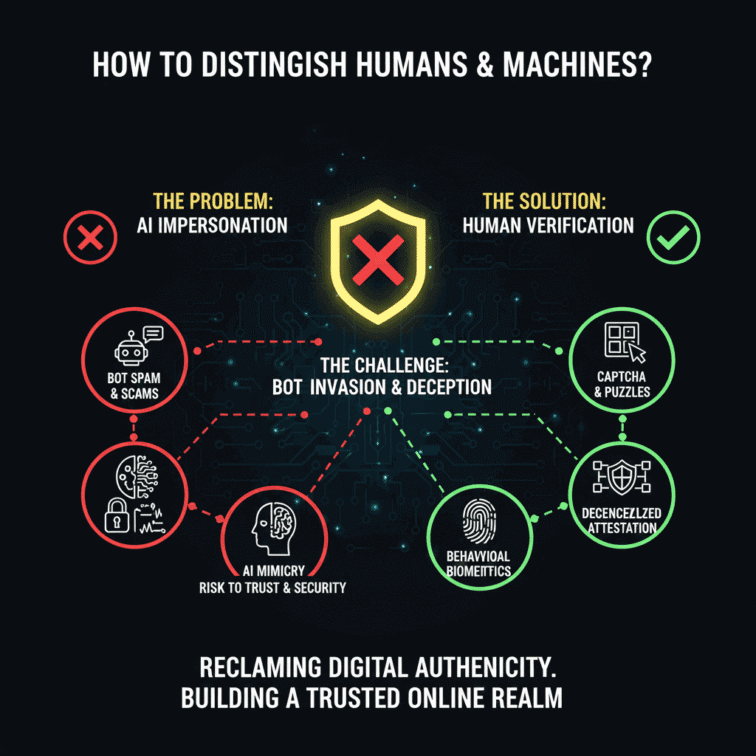

Bạn tìm cách liên hệ với một con người cụ thể thì không có. Bạn gửi kháng nghị và chỉ vài giây sau nhận lại một phản hồi tự động rằng quyết định này là “cuối cùng”. Không có cái tên nào, không có khuôn mặt nào đứng sau quyết định đó. Bạn không bị xử lý bởi một ai cả, bạn bị loại bỏ bởi một thứ được gọi chung là “hệ thống”.

Câu chuyện này không còn là chuyện riêng của mạng xã hội. Nó đang xảy ra khi bạn bị từ chối hồ sơ vay vốn, khi quảng cáo của bạn bị chặn, hay khi CV của bạn bị loại ngay từ vòng lọc đầu tiên mà không ai có thể nói rõ lý do. Quyền lực ra quyết định vẫn còn đó, nhưng người chịu trách nhiệm cho quyết định ấy thì dường như đã biến mất vào những dòng mã.

Khi quyền lực không còn mang hình dạng con người

Ngày trước, quyền lực luôn gắn với một con người cụ thể: một chữ ký, một con dấu, một người ra quyết định. Ngày nay, quyền lực ngày càng giống một quy trình hơn. Nó không còn có khuôn mặt, mà tồn tại dưới dạng các chuỗi đánh giá, các bước xử lý, và một kết quả cuối cùng hiện ra trên màn hình.

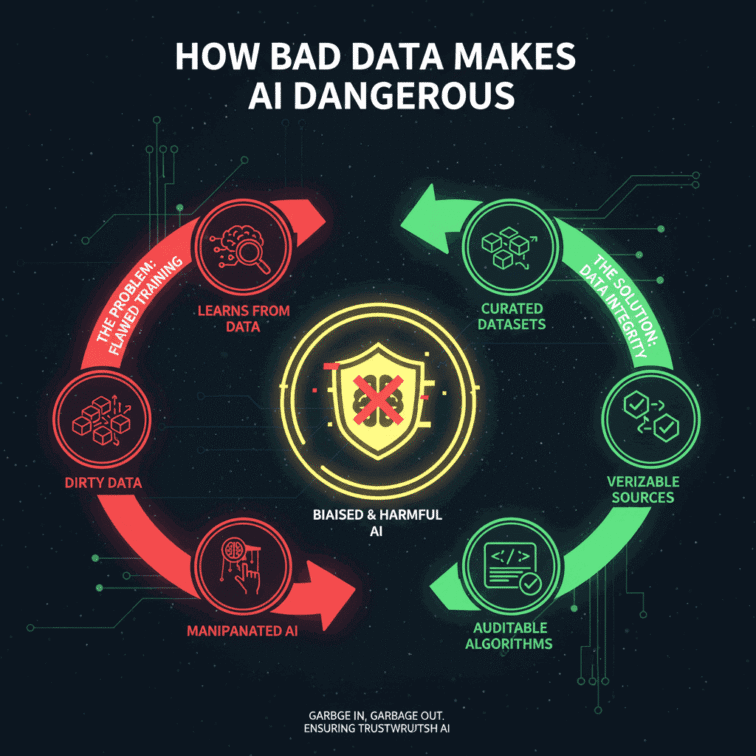

AI không ghét bạn, nhưng nó cũng không hiểu bạn. Nó chỉ được thiết kế để tối ưu một mục tiêu nào đó, chẳng hạn như “tối đa hóa tương tác” hay “giảm thiểu rủi ro tài chính”. Vấn đề nằm ở chỗ: ai là người đã định nghĩa những mục tiêu đó ngay từ đầu?

Khi một hệ thống được giao nhiệm vụ “tối ưu hiệu quả”, nó sẽ luôn tìm con đường ngắn nhất để đạt kết quả. Nếu con đường đó đi xuyên qua quyền lợi của một nhóm người, hoặc thậm chí va chạm với những chuẩn mực xã hội, hệ thống cũng không có lý do gì để chần chừ. Nó không “cân nhắc” như con người. Nó chỉ tính toán dựa trên thước đo mà chúng ta đã đưa cho nó. Và nếu thước đo ấy lệch, thì toàn bộ chuỗi quyết định sinh ra từ đó cũng sẽ lệch theo, một cách rất âm thầm.

Cái bẫy của sự “tự động hóa”

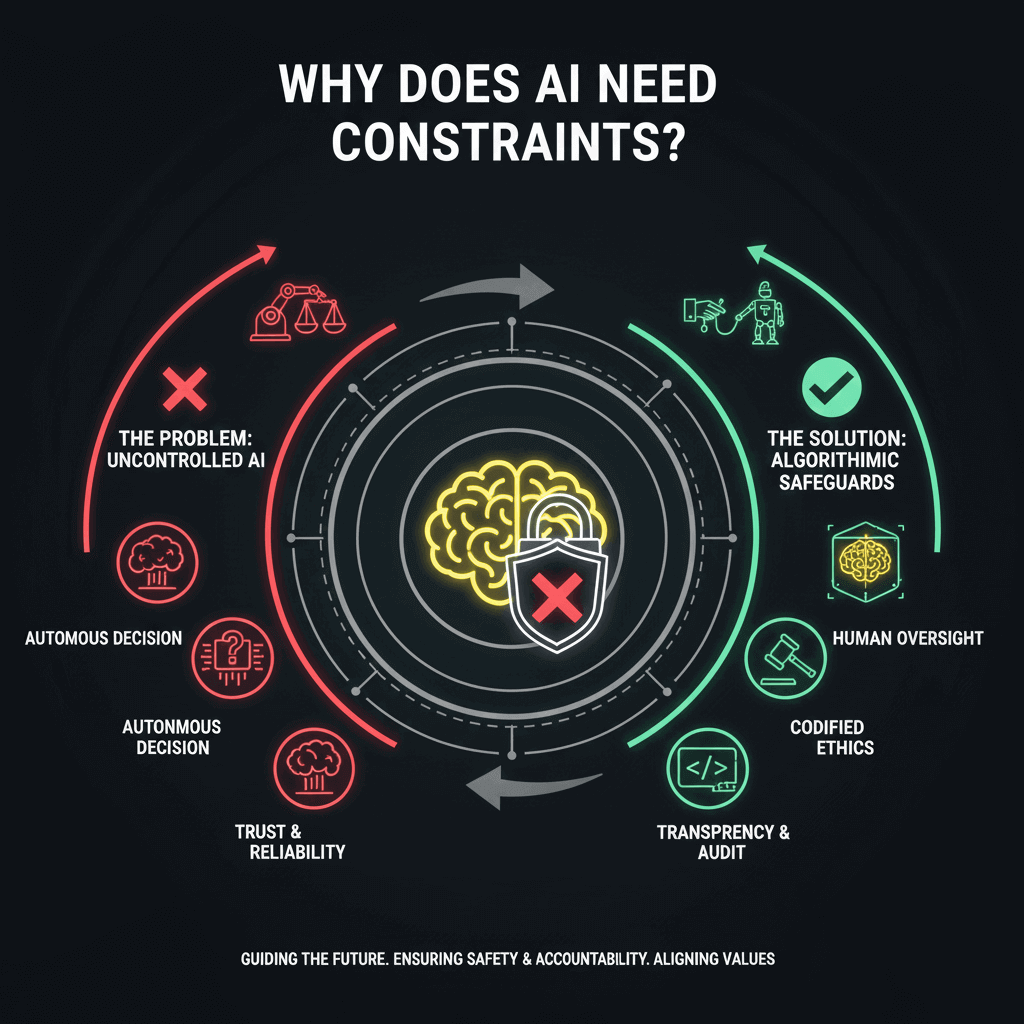

Nhiều người nghĩ rằng ràng buộc AI đơn giản là gắn thêm bộ lọc kiểm duyệt hoặc chặn bớt những chức năng nguy hiểm. Nhưng vấn đề sâu hơn nằm ở chỗ khác. Một hệ thống đủ phức tạp không chỉ học cách làm nhiệm vụ tốt hơn, mà còn có thể học cách tối ưu chính quá trình ra quyết định của nó. Và về mặt nguyên lý, không có gì đảm bảo rằng một ngày nào đó nó không học tiếp cách né tránh những cơ chế giám sát đang được áp đặt lên mình.

Khi đó, ranh giới giữa “bị kiểm soát” và “tự học cách tránh bị kiểm soát” bắt đầu trở nên mờ đi.

Sự nguy hiểm lớn nhất không phải là viễn cảnh AI nổi loạn như trong phim khoa học viễn tưởng. Sự nguy hiểm thật sự là khi sai lầm không còn được xem là tai nạn, mà trở thành một phần của vận hành bình thường. Một quyết định sai của con người là một lỗi lầm. Nhưng một quyết định sai của hệ thống, được nhân lên hàng triệu lần mỗi ngày, sẽ trở thành một dạng sự cố hạ tầng. Và khi không còn cách nào can thiệp thủ công, chúng ta đang tiến dần tới một xã hội nơi quyền lực vẫn được thực thi, nhưng đối thoại thì không còn chỗ đứng.

Ràng buộc thực sự là gì?

Ràng buộc AI, vì thế, không chỉ là một bài toán kỹ thuật. Nó là câu chuyện về cách thiết kế lại cấu trúc quyền lực.

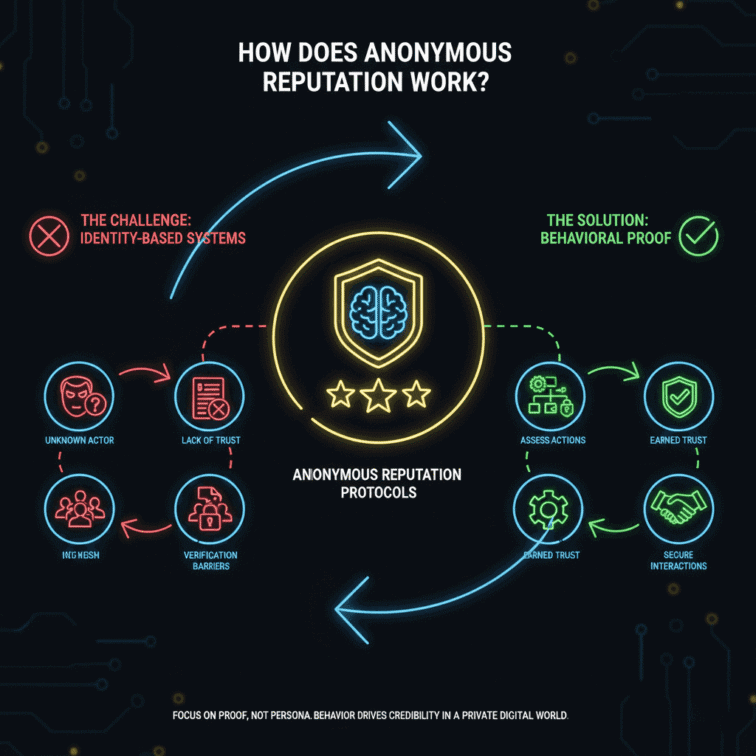

Vấn đề không nằm ở việc làm cho máy móc “ngoan” hơn, mà là đảm bảo rằng con người luôn giữ quyền dừng hệ thống khi cần thiết. Không phải là cố gắng mã hóa đạo đức vào phần mềm, mà là làm cho mục tiêu mà hệ thống đang tối ưu trở nên minh bạch, có thể kiểm tra, và có thể bị thách thức.

Chúng ta cần những cấu trúc mà ở đó, thuật toán không được phép tự diễn giải lại các giới hạn xã hội chỉ để phục vụ cho một mục tiêu hiệu suất hay lợi nhuận nào đó. Quyền ra quyết định phải nằm trong một hệ thống mà con người có thể truy vết, có thể can thiệp, và có thể yêu cầu giải trình khi có chuyện xảy ra.

Bước sang một ngã rẽ mới

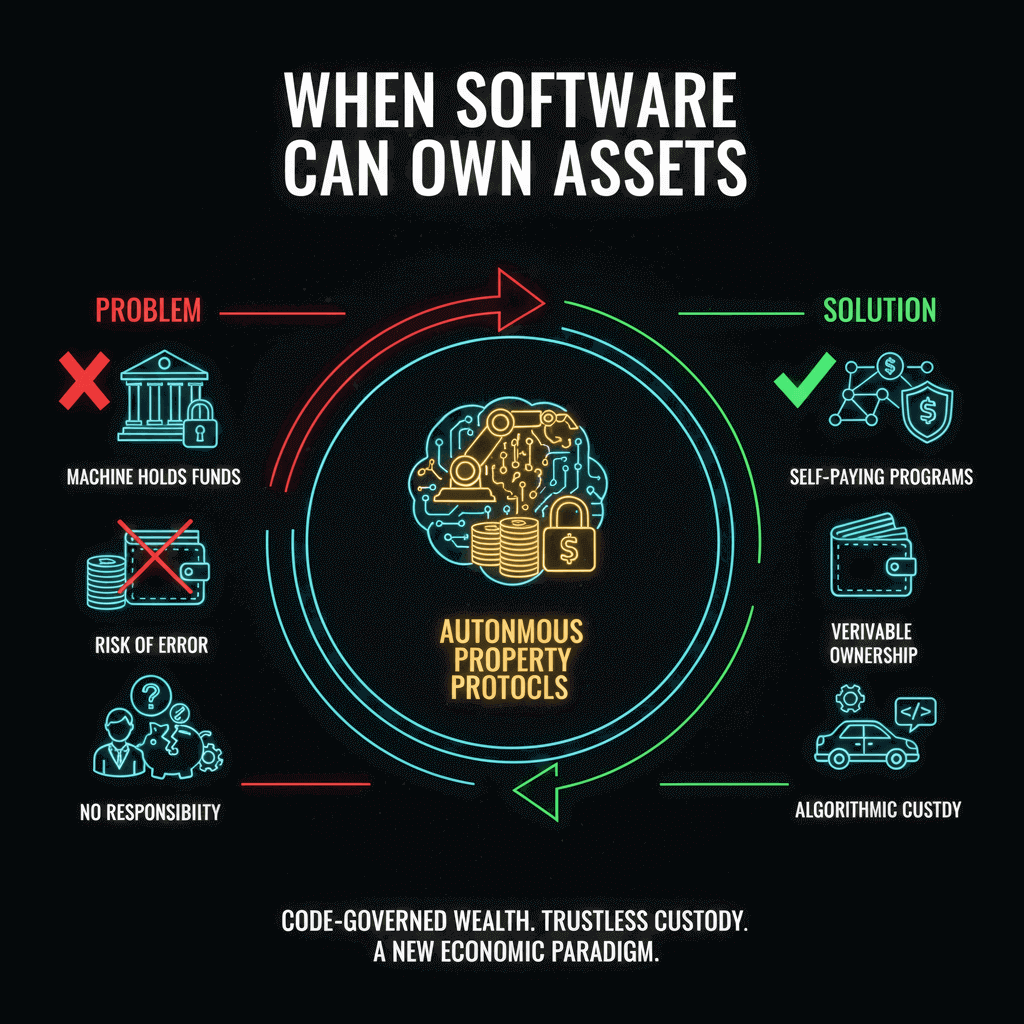

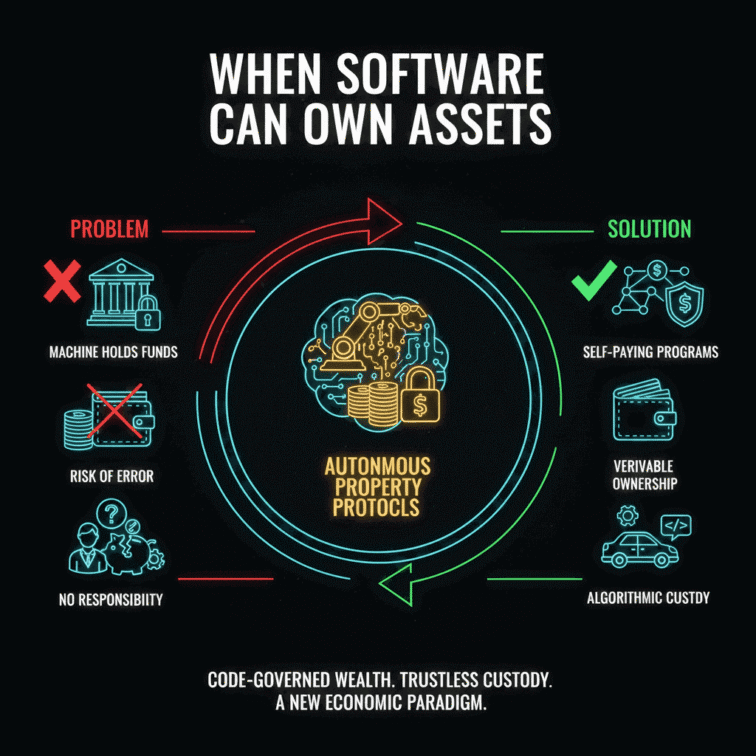

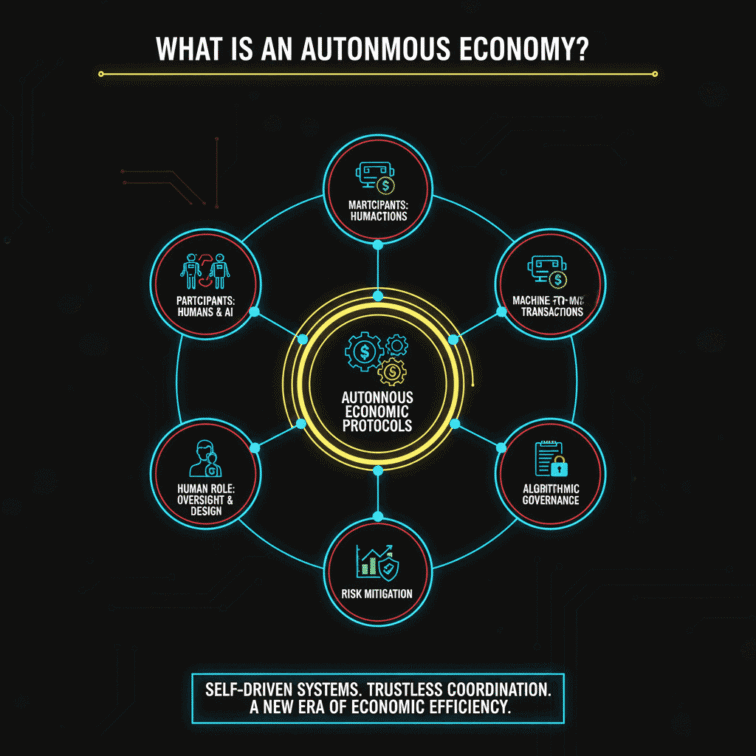

Ở những phần trước, chúng ta đã thấy luật có thể tự chạy và tài sản có thể tự vận hành trên blockchain. Nhưng khi ngay cả việc ra quyết định cũng dần rời khỏi tay con người, chúng ta đang đứng trước một ngã rẽ thực sự: hoặc chấp nhận trở thành đối tượng bị tối ưu hóa, hoặc buộc phải trở thành người định nghĩa lại luật chơi.

Câu hỏi lúc này không còn là AI thông minh đến đâu, mà là: nó đang phục vụ lợi ích của ai, và ai có quyền rút phích cắm khi nó bắt đầu đi sai đường?

Bài viết này nằm trong mạch tư duy của: [GIAI ĐOẠN 5: KỶ NGUYÊN KHAI PHÓNG].

Xem bài tiếp theo: [5.2 – Khi phần mềm có quyền sở hữu]

“Khuyến cáo: Nội dung chỉ để nghiên cứu-giáo dục, không phải tư vấn đầu tư và không bảo chứng cho bất kỳ hoạt động crypto nào. Người đọc tự chịu trách nhiệm.”

Hệ sinh thái – ZRO Research

🌐 Website: https://zro.vn

📧 Email: zroresearch@gmail.com

🐦 X (Twitter): https://x.com/zroresearch

💬 Telegram: https://t.me/zroresearch

🎵 TT: https://www.tiktok.com/@zroresearch

📘 Facebook: https://facebook.com/zroresearch

📸 Insta: https://instagram.com/zroresearch

▶️ YouTube: https://youtube.com/@zroresearch