1. Adversarial Attacks là gì trong bối cảnh Human Verification

Trong Web3, Human Verification không chỉ phải đối phó với bot hay automation thông thường, mà còn đứng trước một lớp đối thủ nguy hiểm hơn nhiều: adversarial AI. Đây là các hệ thống được thiết kế có chủ đích để vượt qua cơ chế xác minh, chứ không phải những hành vi lạm dụng ngẫu nhiên.

Adversarial attacks mang bản chất tối ưu hóa. Chúng liên tục học ngược từ phản hồi của hệ thống phòng thủ, điều chỉnh chiến lược để đạt ngưỡng chấp nhận mà không cần phá vỡ hoàn toàn cơ chế xác minh. Trong bối cảnh này, Human Verification trở thành một cuộc chạy đua vũ trang, nơi AI tấn công và AI phòng thủ cùng tiến hóa.

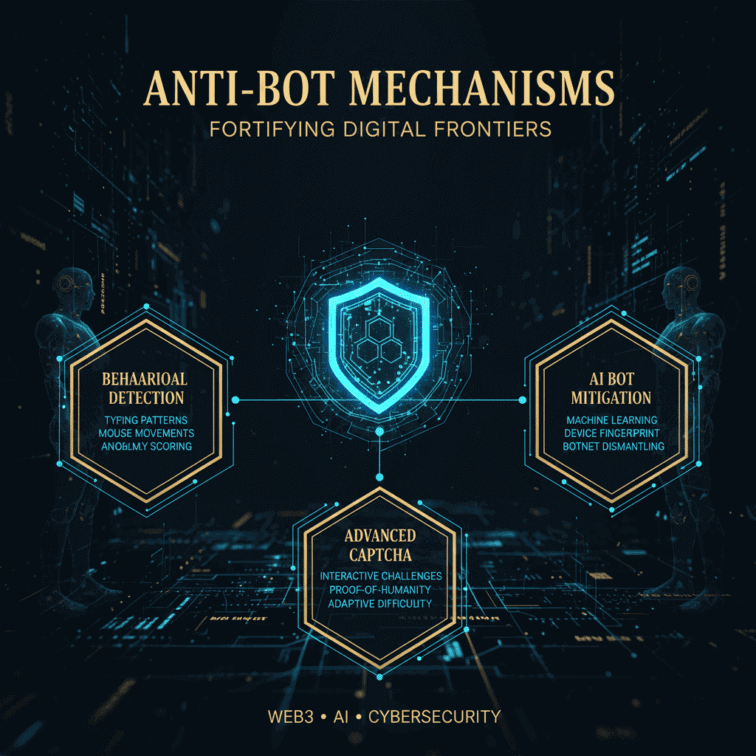

2. Vì sao Adversarial Attacks không thể gộp chung với Anti bot

Anti bot tập trung vào việc ngăn chặn script, automation quy mô lớn và các hành vi lặp lại dễ nhận diện. Ngược lại, adversarial attacks nhắm vào bản thân mô hình xác minh, khai thác các giới hạn thống kê và hành vi học máy.

AI spoofing, replay được tối ưu hóa, deepfake thời gian thực và thao túng ở tầng sensor là những mối đe dọa vượt xa phạm vi của anti bot truyền thống. Hai threat class này khác nhau về động cơ, công cụ và yêu cầu phòng thủ, do đó cần được tách thành các lớp kiến trúc riêng biệt.

3. Threat model tổng quát của Adversarial Attacks

Một adversarial attacker thường có khả năng thu thập phản hồi từ hệ thống, sở hữu tài nguyên tính toán để huấn luyện mô hình đối kháng và theo đuổi mục tiêu vượt qua Human Verification một cách ổn định theo thời gian. Attacker không cần phá vỡ hoàn toàn hệ thống, mà chỉ cần đạt mức chấp nhận đủ để được xem là con người.

Trong mô hình này, đối thủ có thể là AI thuần túy hoặc tổ hợp giữa con người và AI. Chiến lược tấn công thường dựa trên gradient based hoặc black box learning, nơi hệ thống phòng thủ vô tình trở thành nguồn dữ liệu huấn luyện cho kẻ tấn công.

4. Các dạng Adversarial Attacks phổ biến

4.1 AI Spoofing Attacks

AI spoofing xảy ra khi hệ thống AI chủ động bắt chước hành vi người dùng thật. Thay vì automation thô, attacker tối ưu các tín hiệu hành vi như nhịp gõ phím, chuyển động chuột hay cách tương tác giao diện để vượt qua behavioral verification. Điều này lý giải vì sao xác minh hành vi không thể đứng một mình trong kiến trúc Human Verification.

4.2 Replay Attacks nâng cao

Replay attack trong bối cảnh adversarial không còn là việc phát lại nguyên trạng video hay audio. Attacker thêm noise thích ứng, điều chỉnh timing của frame, biến đổi đặc trưng âm thanh hoặc làm giàu entropy dữ liệu để tránh các signature detection quen thuộc. Replay trở thành một quá trình sinh dữ liệu, không còn là sao chép thụ động.

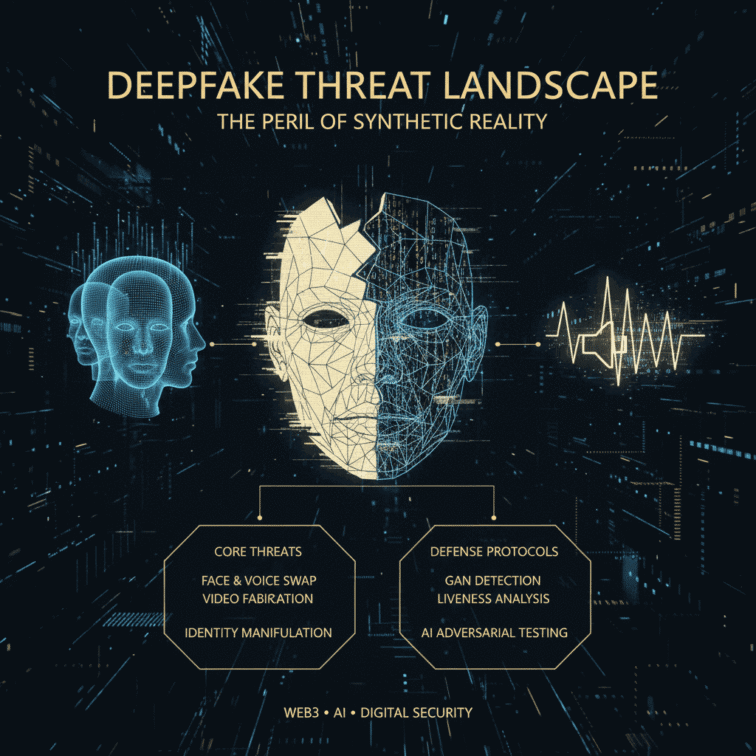

4.3 Deepfake thời gian thực

Deepfake real time là mối đe dọa nghiêm trọng nhất đối với các hệ thống dựa vào sinh trắc học. Khác với deepfake offline, dạng tấn công này có thể phản hồi challenge, thay đổi biểu cảm theo yêu cầu và duy trì tính nhất quán đủ lâu để vượt qua xác minh. Các detector tĩnh gần như không đủ khả năng đối phó.

4.4 Sensor level manipulation

Thay vì giả mạo dữ liệu đầu ra, attacker can thiệp trực tiếp vào luồng dữ liệu từ camera, microphone hoặc cảm biến độ sâu. Việc hook driver, chỉnh sửa stream hoặc thao túng tín hiệu IR khiến giả định về tính đúng đắn của input trở nên mong manh. Nếu hệ thống chỉ tin vào dữ liệu đầu vào, thất bại là điều tất yếu.

5. Vì sao không tồn tại phòng thủ tuyệt đối

Một nguyên lý cốt lõi của học máy là nếu một hệ thống có thể được học, nó cũng có thể bị học ngược. Điều này đồng nghĩa với việc không tồn tại detector hoàn hảo hay mô hình bất khả xâm phạm. Mục tiêu thực tế của Human Verification không phải loại bỏ hoàn toàn adversarial attacks, mà là tăng chi phí, giảm độ ổn định và làm cho tấn công khó mở rộng.

6. Adversarial Training như nền tảng phòng thủ

Adversarial training là quá trình chủ động sinh dữ liệu tấn công và huấn luyện mô hình trên cả dữ liệu thật lẫn giả. Trong Human Verification, cách tiếp cận này được áp dụng cho phân tích hành vi với dữ liệu AI generated, liveness detection với deepfake mẫu và phát hiện bất thường sensor từ stream bị làm nhiễu.

Đổi lại cho độ bền cao hơn là chi phí tính toán lớn, yêu cầu bảo trì liên tục và khả năng tăng friction nếu không kiểm soát tốt.

7. Fuzz Testing cho hệ thống xác minh

Trong bối cảnh này, fuzz testing không nhằm kiểm tra logic code, mà tập trung bơm dữ liệu ngẫu nhiên hoặc bán ngẫu nhiên vào pipeline xác minh. Bằng cách quan sát phản ứng của hệ thống trước behavioral fuzzing, sensor fuzzing hay timing fuzzing, các điểm yếu phi tuyến và edge case có thể được phát hiện sớm.

8. Sensor Anomaly Detection

Sensor là điểm yếu tự nhiên vì chúng là nguồn dữ liệu gốc và khó kiểm chứng tính toàn vẹn. Sensor anomaly detection so sánh tín hiệu quan sát được với baseline vật lý, tìm các pattern không tự nhiên và đối chiếu chéo giữa nhiều loại sensor. Những sai lệch như IR và RGB không khớp, motion vector bất thường hay entropy thấp ở depth map là chỉ dấu quan trọng của tấn công.

9. Multi layer Defense trong Human Verification

Không có lớp phòng thủ đơn lẻ nào đủ sức chống adversarial attacks. Sức mạnh của hệ thống nằm ở sự kết hợp giữa xác thực sensor, phân tích liveness, kiểm tra nhất quán hành vi, tương quan đa yếu tố và cơ chế chấm điểm rủi ro. Chính sự chồng lớp này làm tăng chi phí và giảm độ ổn định của tấn công.

10. Adaptive Defense và Moving Target

Adversarial attacks phát huy hiệu quả cao nhất khi hệ thống phòng thủ tĩnh, threshold cố định và challenge lặp lại. Do đó, defense hiệu quả cần thay đổi liên tục thông qua randomized challenge, threshold thích ứng và cập nhật mô hình thường xuyên. Đây là triết lý moving target defense, khiến attacker khó hội tụ chiến lược tối ưu.

11. Trade off giữa Robustness và Privacy

Thu thập nhiều dữ liệu giúp detection tốt hơn, nhưng đồng thời làm tăng rủi ro quyền riêng tư. Giải pháp thực tế là không lưu dữ liệu thô, thực hiện trích xuất đặc trưng cục bộ và chỉ tạo proof khi cần thiết. Robustness không được đánh đổi privacy, ngay cả trong bối cảnh adversarial.

12. Use case Web3 chịu ảnh hưởng trực tiếp

12.1 DAO Governance

Adversarial defense giúp ngăn AI thao túng voting, phát hiện hành vi phối hợp tinh vi và bảo vệ tính toàn vẹn của governance khi kết hợp với Multi factor Verification.

12.2 High value Transaction Safeguard

Với các giao dịch giá trị cao, hệ thống có thể kích hoạt step up verification và liveness challenge thích ứng khi nghi ngờ spoofing, trong khi vẫn giữ UX ổn định cho các thao tác thông thường.

13. Giới hạn hiện tại của phòng thủ adversarial

AI tấn công tiến hóa nhanh hơn defense, chi phí bảo trì cao và không thể formal verify toàn bộ hệ thống. Do đó, kỳ vọng cần thực tế: mục tiêu là giảm rủi ro chứ không loại bỏ hoàn toàn.

14. Xu hướng tương lai

Các hướng phát triển bao gồm continual adversarial learning, đồng tiến hóa AI tấn công và phòng thủ, xác minh dựa trên phần cứng và proof dựa trên zero knowledge cho các tuyên bố về độ bền hệ thống.

15. Kết luận

Adversarial attacks không phải ngoại lệ, mà là trạng thái mặc định của Human Verification trong kỷ nguyên AI. Một hệ thống xác minh nghiêm túc phải giả định luôn bị tấn công, thiết kế cho failure, tăng chi phí đối kháng và không hy sinh quyền riêng tư. Robustness không đến từ niềm tin, mà đến từ kiến trúc.

Bài viết này chỉ là một lát cắt, toàn bộ kiến trúc xác minh con người trong Web3 được trình bày đầy đủ tại:

[SILO 5 – Human Verification].

Xem tiếp bài viết:

[5.7 – Privacy safe Biometrics trong Human Verification Web3]

“Khuyến cáo: Nội dung chỉ để nghiên cứu-giáo dục, không phải tư vấn đầu tư và không bảo chứng cho bất kỳ hoạt động crypto nào. Người đọc tự chịu trách nhiệm.”

Hệ sinh thái – ZRO Research

🌐 Website: https://zro.vn

📧 Email: zroresearch@gmail.com

🐦 X (Twitter): https://x.com/zroresearch

💬 Telegram: https://t.me/zroresearch

🎵 TT: https://www.tiktok.com/@zroresearch

📘 Facebook: https://facebook.com/zroresearch

📸 Insta: https://instagram.com/zroresearch

▶️ YouTube: https://youtube.com/@zroresearch